Về việc xây dựng quá mức, tín hiệu nhu cầu và các đợt xây dựng cơ sở hạ tầng trước đây

Xin chào các bạn,

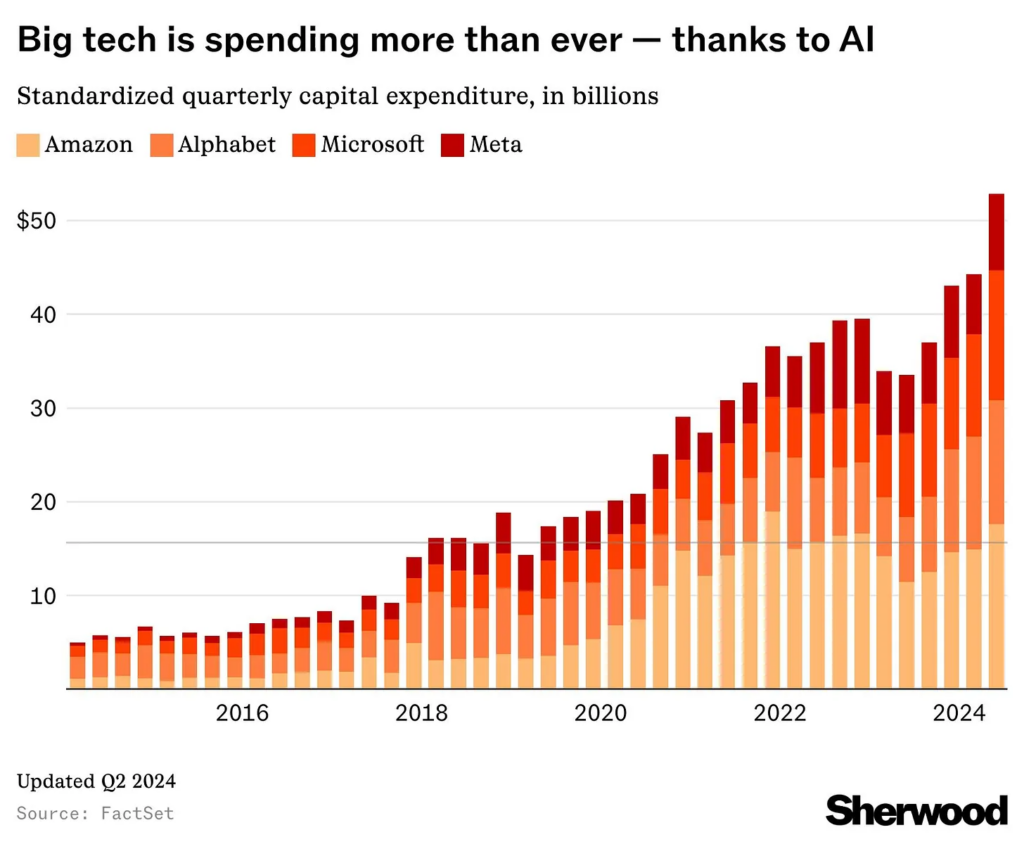

Các cuộc gọi báo cáo thu nhập gần đây từ các công ty công nghệ lớn đã tái khẳng định cam kết của họ trong việc đổ một lượng vốn khổng lồ vào cơ sở hạ tầng liên quan đến AI. Trong bài viết này, tôi sẽ khám phá về sự đầu tư quá mức vào AI và cách nó phản ánh các đợt bùng nổ đầu tư trong quá khứ.

Sự Đầu tư Quá mức vào AI

Trong các cuộc gọi báo cáo thu nhập mới nhất, Google, Amazon, Meta và Microsoft đều chia sẻ một thông điệp chung – tiếp tục tăng cường chi tiêu vốn (capex) cho cơ sở hạ tầng AI đến năm 2025. Các con số thật đáng kinh ngạc: tổng capex hơn 50 tỷ đô la mỗi quý vào quý 4 năm nay.

Một chủ đề chung trong các cuộc gọi này là sự thừa nhận về khả năng đầu tư quá mức. Tuy nhiên, quan điểm chung rất rõ ràng: rủi ro của việc đầu tư không đủ còn đáng sợ hơn nhiều so với việc đầu tư quá mức.

Mark Zuckerberg đã lưu ý trong một cuộc phỏng vấn gần đây với Bloomberg:

“Tôi nghĩ rằng có một khả năng đáng kể là nhiều công ty đang xây dựng quá mức hiện nay, và khi nhìn lại, bạn sẽ nhận ra rằng, ‘ồ, có lẽ tất cả chúng ta đã chi tiêu nhiều hơn một vài tỷ đô la so với mức cần thiết … Mặt khác, tôi thực sự nghĩ rằng tất cả các công ty đang đầu tư đều đang đưa ra quyết định hợp lý, bởi vì hậu quả của việc tụt hậu là bạn sẽ bị mất vị thế trong công nghệ quan trọng nhất trong 10 đến 15 năm tới.”

Sundar Pichai cũng bày tỏ quan điểm tương tự trong cuộc họp báo cáo thu nhập của Google:

Và trong lĩnh vực công nghệ, khi bạn đang trải qua những giai đoạn chuyển đổi này, việc đầu tư mạnh mẽ ngay từ đầu vào một lĩnh vực định hình, đặc biệt là trong một lĩnh vực mà theo cách đòn bẩy, ảnh hưởng đến tất cả các lĩnh vực cốt lõi của chúng ta, các sản phẩm của chúng ta, bao gồm Tìm kiếm, YouTube và Các Dịch vụ Khác cũng như thúc đẩy sự tăng trưởng trong Điện toán Đám mây và hỗ trợ các khoản đặt cược đổi mới dài hạn và Các Khoản Đặt cược Khác. Đó chắc chắn là điều mà đối với chúng ta, việc tập trung vào là có ý nghĩa.

Một cách mà tôi nghĩ về điều này là khi bạn trải qua một đường cong như thế này, rủi ro của việc đầu tư không đủ lớn hơn đáng kể so với rủi ro của việc đầu tư quá mức đối với chúng ta ở đây. Nhưng tôi nghĩ rằng việc không đầu tư để đứng ở vị trí hàng đầu ở đây, theo tôi, chắc chắn có những mặt tiêu cực đáng kể hơn nhiều.

Xây dựng quá mức trong quá khứ

Đây không phải là lần đầu tiên chúng ta chứng kiến một cuộc xây dựng cơ sở hạ tầng lớn được thúc đẩy bởi nỗi sợ bỏ lỡ. Lịch sử đầy rẫy những ví dụ—từ kênh đào đến đường sắt đến viễn thông—nơi mà sự gia tăng đột ngột về đầu tư dẫn đến cả sự đổi mới và sự dư thừa.

Trong trường hợp kênh đào vào cuối thế kỷ 18, một số lượng lớn các công ty mới đã xuất hiện, huy động vốn từ công chúng đầu cơ để xây dựng cơ sở hạ tầng.

Từ cuối thế kỷ 18 đến năm 1824, hơn 60 công ty kênh đào đã được thành lập, huy động được hơn 12 triệu bảng Anh vốn mới, tương đương với khoảng 12 tỷ đô la theo giá trị tiền tệ ngày nay. Nhu cầu về cổ phiếu kênh đào lớn đến mức vốn đã được huy động rộng rãi từ việc đăng ký công khai ở quy mô chưa từng có.

Việc xây dựng viễn thông mà chúng ta thấy vào những năm 2000 thậm chí còn lấn át cả những gì chúng ta thấy trong AI ngày nay, khi gần 250 tỷ đô la chi phí vốn được chi trên toàn cầu. Cuối cùng, việc xây dựng quá mức này dẫn đến tình trạng dư thừa công suất chưa sử dụng, dẫn đến tổn thất tài chính đáng kể khi bong bóng dot-com vỡ.

Một lượng vốn khổng lồ đổ vào xây dựng cả mạng cáp quang và mạng không dây để hỗ trợ cho sự tăng trưởng dự kiến của một “thế giới kết nối”, một hiện tượng mà Internet được kỳ vọng sẽ góp phần hiện thực hóa. Phần lớn vốn trong trường hợp này đã được chuyển hướng vào tay các chính phủ dưới hình thức đấu giá giấy phép không dây. Một cuộc đấu giá giấy phép điện thoại di động thế hệ thứ ba (3g) ở Anh và Châu Âu đã dẫn đến việc 150 tỷ đô la được trả cho nhiều chính phủ Châu Âu dưới dạng tiền đấu giá, chỉ để có được quyền hoạt động. Số tiền tương tự một lần nữa được huy động để xây dựng cơ sở hạ tầng 3g trước khi có thể sử dụng giấy phép và kiếm được bất kỳ khoản doanh thu nào. Tổng chi tiêu vốn toàn cầu cho riêng lĩnh vực viễn thông vào năm 2000 là 243 tỷ đô la, một con số lớn hơn gấp hai lần rưỡi so với số tiền đầu tư năm năm trước đó . Trong con số này, các yếu tố lớn nhất liên quan đến Internet, cho dù là để truy cập băng thông rộng, mạng quang hay cơ sở hạ tầng không dây.

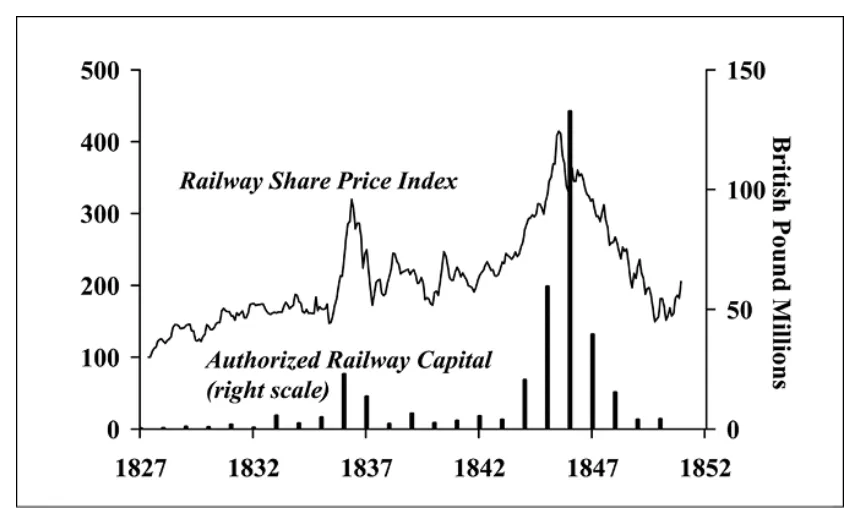

Một hiện tượng tương tự đã xảy ra trong ngành đường sắt khi có sự gia tăng lớn về vốn chảy vào các công ty này (và sau đó được các công ty này đầu tư), sau cơn “cơn sốt” và đầu cơ, như thể hiện rõ trong biểu đồ bên dưới về Đường sắt Anh.

Lần này có gì khác biệt?

Mặc dù lịch sử có vẻ đúng, nhưng sự bùng nổ AI ngày nay cũng có một số đặc điểm độc đáo.

I. Tín hiệu cầu mạnh

Một điểm khác biệt chính là sự hiện diện của các tín hiệu nhu cầu mạnh hơn hiện nay. Không giống như các chu kỳ trước, khi cơ sở hạ tầng được xây dựng dựa trên hy vọng và kỳ vọng rằng nhu cầu sẽ theo sau, các công ty công nghệ lớn đang thấy nhu cầu thực tế, hữu hình thúc đẩy các khoản đầu tư AI của họ.

Ví dụ, Microsoft đã nhấn mạnh sự phát triển của Azure AI đang dẫn dắt hoạt động kinh doanh đám mây của họ và họ đang thấy nhu cầu ngày càng tăng:

Tăng trưởng Azure AI, đó là nơi đầu tiên chúng ta xem xét. Sau đó, điều đó thúc đẩy phần lớn chi tiêu capex, về cơ bản, đó là tín hiệu nhu cầu vì bạn phải nhớ rằng, ngay cả trong chi tiêu vốn, vẫn có đất và có xây dựng trung tâm dữ liệu, nhưng hơn 60 phần trăm là bộ dụng cụ, chỉ được mua để suy luận và mọi thứ khác nếu có tín hiệu nhu cầu, đúng không ? Vì vậy, tôi nghĩ đó là cách chính để suy nghĩ về chu kỳ vốn.

Để đáp ứng nhu cầu ngày càng tăng đối với các sản phẩm AI và đám mây của chúng tôi, chúng tôi sẽ mở rộng quy mô đầu tư vào cơ sở hạ tầng với chi phí vốn năm tài chính 25 dự kiến sẽ cao hơn năm tài chính 24. Xin nhắc lại, các khoản chi này phụ thuộc vào tín hiệu nhu cầu và việc áp dụng các dịch vụ của chúng tôi sẽ được quản lý trong suốt cả năm.

Amazon cũng đồng tình với quan điểm này:

Nhìn về phần còn lại của năm 2024, chúng tôi kỳ vọng các khoản đầu tư vốn sẽ cao hơn trong nửa cuối năm. Phần lớn chi tiêu sẽ là để hỗ trợ nhu cầu ngày càng tăng đối với cơ sở hạ tầng AWS khi chúng tôi tiếp tục thấy nhu cầu mạnh mẽ trong cả AI tạo ra và khối lượng công việc AI không tạo ra của chúng tôi .

Nhưng không phải tất cả đều chắc chắn. Ví dụ, Meta không kỳ vọng các sản phẩm GenAI của mình sẽ mang lại doanh thu đáng kể trong thời gian tới:

Chúng tôi không kỳ vọng các sản phẩm GenAI của mình sẽ là động lực có ý nghĩa cho doanh thu vào năm 2024. Nhưng chúng tôi kỳ vọng rằng chúng sẽ mở ra những cơ hội doanh thu mới theo thời gian, cho phép chúng tôi tạo ra lợi nhuận vững chắc từ khoản đầu tư của mình

II. Tính linh hoạt của cơ sở hạ tầng

Một điểm khác biệt nữa là tính linh hoạt của cơ sở hạ tầng hiện nay – cơ sở hạ tầng có tuổi thọ sử dụng lâu dài, có thể được tái sử dụng theo nhiều cách khác nhau và một phần chi tiêu có thể phù hợp với nhu cầu thực tế.

Sundar Pichai lưu ý:

Ngay cả trong những tình huống mà chúng ta đầu tư quá mức, thì đây vẫn là những cơ sở hạ tầng có ích cho chúng ta, chúng có tuổi thọ lâu dài và chúng ta có thể áp dụng chúng trên diện rộng và chúng ta có thể giải quyết vấn đề đó .

Satya Nadella cũng đề cập đến tính linh hoạt khi chỉ chi tiêu phần lớn vốn khi cần thiết.

Tài sản, như Amy đã nói, là tài sản dài hạn, đó là đất đai và trung tâm dữ liệu, mà nhân tiện, chúng tôi thậm chí không xây dựng mọi thứ hoàn chỉnh, chúng tôi thậm chí có thể có những thứ được xây dựng một nửa, chúng tôi gọi là kệ than, v.v. Vì vậy, chúng tôi biết cách quản lý chi tiêu vốn đầu tư để xây dựng tài sản dài hạn và rất nhiều quá trình hydrat hóa bộ dụng cụ diễn ra khi chúng tôi có tín hiệu nhu cầu .

III. Tập trung và tập trung hóa

Trước đây, việc xây dựng quá mức thường do một nhóm các công ty nhỏ và các nhà đầu tư đầu cơ thúc đẩy, dẫn đến thị trường phân mảnh và kém hiệu quả. Ví dụ, sự bùng nổ của đường sắt đã chứng kiến nhiều công ty nhỏ cạnh tranh để giành tuyến đường, dẫn đến tình trạng trùng lặp và thảm họa tài chính khi lợi nhuận dự kiến không đạt được.

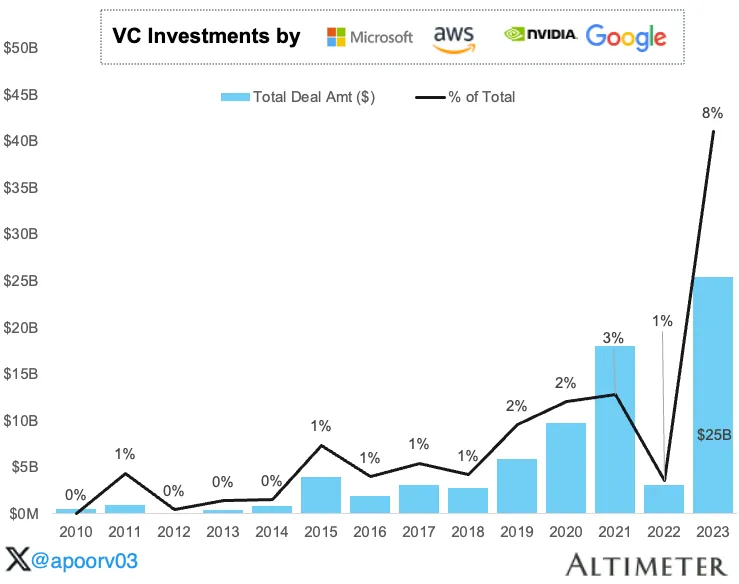

Ngày nay, trong khi chúng ta đã chứng kiến một loạt các công ty khởi nghiệp mới và các khoản đầu tư vốn mạo hiểm đáng kể—khoảng 20 tỷ đô la mỗi quý vào AI—thì bối cảnh lại khác. Không giống như những giai đoạn trước đó, phần lớn đầu tư vào cơ sở hạ tầng AI tập trung trong tay chỉ năm đến bảy công ty lớn. Chắc chắn, vẫn còn sự đầu cơ, đặc biệt là giữa các công ty AI được giao dịch công khai, nhưng nó vẫn chưa đạt đến đỉnh điểm của các đợt bùng nổ trong quá khứ.

Điều đặc biệt thú vị là ngay cả những công ty khởi nghiệp AI triển vọng nhất thường cũng được các công ty công nghệ lớn hơn này tài trợ tại một thời điểm nào đó trong hành trình của họ, như được nêu bật bên dưới trong biểu đồ của Apoorv’s notes bởi

Sự tập trung này đánh dấu sự thay đổi từ việc xây dựng quá mức mang tính đầu cơ, phi tập trung hơn trong quá khứ. Chu kỳ hiện tại phần lớn được thúc đẩy bởi dòng tiền tự do và lợi nhuận của các công ty công nghệ lớn này, giúp giảm bớt một số rủi ro liên quan đến việc xây dựng quá mức. Ít nhất, điều đó có nghĩa là các nhà đầu tư cá nhân đầu cơ không phải chịu trực tiếp hậu quả tiềm tàng nếu mọi thứ không diễn ra như kế hoạch.

Suy nghĩ kết thúc

Sự bùng nổ AI có những điểm tương đồng đáng kinh ngạc với các giai đoạn xây dựng quá mức trước đây—chi tiêu vốn lớn và mối đe dọa lờ mờ của tình trạng dư thừa năng lực. Nhưng lần này, tín hiệu nhu cầu mạnh mẽ và cơ sở hạ tầng thích ứng có thể dẫn đến một kết quả khác. Tuy nhiên, lịch sử vẫn có những bài học giá trị để cung cấp. Xây dựng quá mức, ngay cả khi được thúc đẩy bởi nhu cầu thực tế, cũng đi kèm với những rủi ro đáng kể. Câu hỏi lớn là liệu nhu cầu về AI có theo kịp tốc độ mở rộng nhanh chóng này hay không, hoặc liệu giống như trong các chu kỳ trước, chúng ta sẽ thấy cung vượt cầu và vượt cầu bao nhiêu.

Tất cả các trích dẫn và biểu đồ trong phần này đều lấy từ Engines that Move Markets của Alasdair Nairn

Tác giả: Tanay Jaipuria – tanayj.com – bài đăng vào ngày 19/08/2024

Link bài gốc: Overbuilding in AI: A Modern Twist on an Old Tale

Dịch giả: Hoàng Phan – KenkAI Nhiều thứ hay

(*) Bạn có thể sao chép và chia sẻ thoải mái.

(**) Follow KenkAI Nhiều thứ hay để đọc các bài dịch khác và cập nhật thông tin bổ ích hằng ngày.

Để lại một bình luận